2020年2月11日 第553页

-

使用Logstash将Kafka数据写入AnalyticDB for MySQL_使用Logstash将Kafka数据写入AnalyticDB for MySQL_消息队列_数据接入_分析型数据库MySQL版

使用Logstash将Kafka数据写入AnalyticDB for MySQL 步骤一:安装插件logstash从1.5版本开始集成Kafka,logstash 1.5及以上版本中所有插件的目录和命名都发生了改变,插件发布地址为logstash-plugins,您可以通过以下命令安装和更新插件。 $bin/p...

-

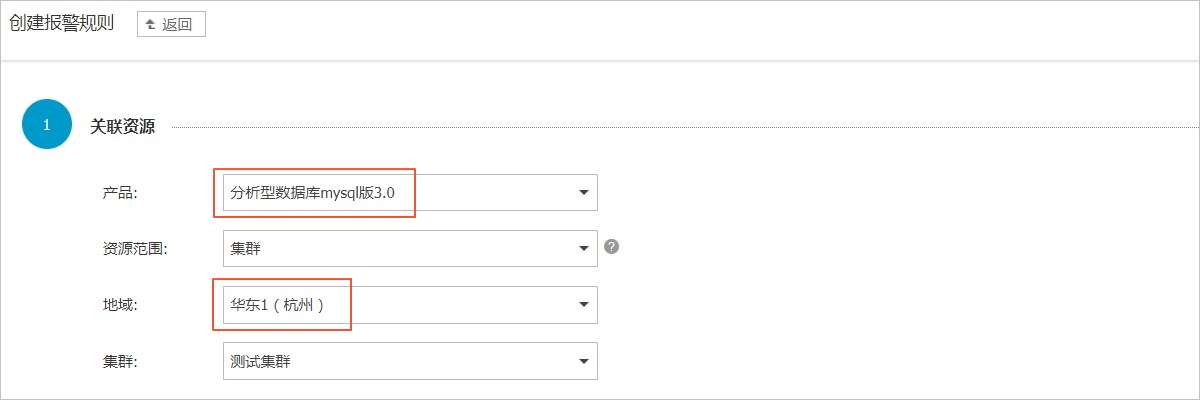

报警规则设置_监控与报警_分析型数据库MySQL版

报警规则设置 本文介绍如何通过云监控控制台为AnalyticDB for MySQL设置报警规则。 背景信息监控报警是通过阿里云监控产品实现的。通过阿里云监控产品,您可以设置监控项,并在触发监控项报警规则时,通知报警联系组中的所有联系人。您也可以维护报警监控项对应的报警联系组,以便发生报警时,能及时通知到相关联...

-

使用LOAD DATA导入本地数据_本地数据_数据接入_分析型数据库MySQL版

使用LOAD DATA导入本地数据 语法LOAD DATA LOCAL INFILE 'file_name' [REPLACE | IGNORE] INTO TABLE table_name [{FIELDS | COLUMNS} [TERMINATED BY 'strin...

-

配置AnalyticDB for MySQL数据源_通过DataWorks导入Hadoop数据_大数据_数据接入_分析型数据库MySQL版

配置AnalyticDB for MySQL数据源 详情请参见配置AnalyticDB for MySQL数据源。...

-

配置同步任务中的数据来源和去向_通过DataWorks导入Hadoop数据_大数据_数据接入_分析型数据库MySQL版

配置同步任务中的数据来源和去向 您可以参照使用DataWorks同步RDS for MySQL数据文档配置同步任务,将Hadoop中的数据同步至AnalyticDB for MySQL。...

-

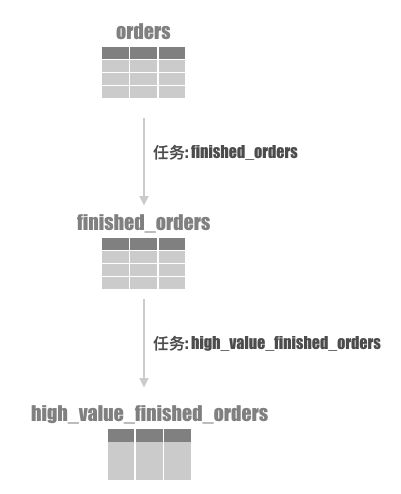

DataWorks调度AnalyticDB for MySQL任务_数仓开发_分析型数据库MySQL版

DataWorks调度AnalyticDB for MySQL任务 背景信息DataWorks是基于MaxCompute作为计算和存储引擎的用于工作流可视化开发和托管调度运维的海量数据离线加工分析平台,支持按照时间和依赖关系的任务全面托管调度。AnalyticDB for MySQL用户可以通过DataWork...

-

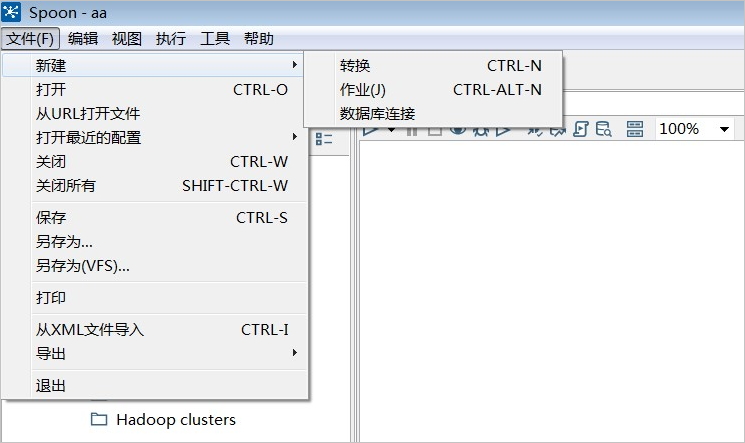

使用Kettle将本地数据同步至AnalyticDB for MySQL_数仓开发_分析型数据库MySQL版

使用Kettle将本地数据同步至AnalyticDB for MySQL 本文以Excel为例,介绍如何通过Kettle将本地Excel数据同步至AnalyticDB for MySQL。 背景信息Kettle是一款非常受欢迎的开源ETL工具软件,主要用于数据整合、转换和迁移。Kettle不仅支持各类关系型数据...

-

将MaxCompute数据导入AnalyticDB for MySQL_通过INSERT外表方式导入导出MaxCompute数据_大数据_数据接入_分析型数据库MySQL版

将MaxCompute数据导入AnalyticDB for MySQL 前提条件 根据MaxCompute准备工作和快速入门在MaxCompute中准备数据源。 例如通过CREATE TABLE,在MaxCompute中创建以下数据表。如果您已经有数据源,请跳过该步骤。 CREATE TABLE IF...

-

配置MaxCompute数据源_通过DataWorks导入MaxCompute数据_大数据_数据接入_分析型数据库MySQL版

配置MaxCompute数据源 本文介绍如何配置MaxCompute数据源,详情请参见配置MaxCompute数据源。...

-

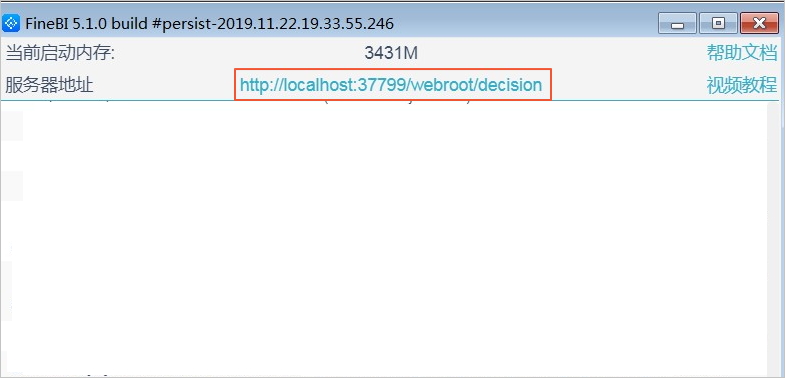

FineBI_数据可视化_分析型数据库MySQL版

FineBI 本文介绍如何通过FineBI连接AnalyticDB for MySQL集群并进行实时数据分析。 准备工作开始使用FineBI前,您需要完成以下准备工作。 安装MySQL JDBC驱动。 安装FineBI 5.0及以上版本。 如果您是第一次安装FineBI,需要安装MySQL服务器(例如阿里云R...